如果你正在找一篇可直接上手的 Seedance 2.0 tutorial,这篇会给你一条可复用的生产流程:

- 新手可以按步骤做出第一条可发布短片

- 进阶创作者可以提升镜头稳定性与角色一致性

- 开发者可以直接接 API 批量生成视频

如果你想立刻实操这篇 seedance2 tutorial,可以先打开 AI Video Generator,或先回到 VibeVideo 首页 看完整入口。

先说结论

- Seedance 2.0 的核心是多模态输入(文本、图片、视频、音频)+ 音视频联合生成。

- 最稳的实操路径是:先锁定参考,再写结构化 Prompt,再做单变量迭代。

- 截至 2026-02-12,不同平台的开放节奏不一致;如果你暂时没有 2.0 权限,可先用 Seedance 1.5 Pro 跑。

文中的示例图与示例视频会穿插在对应步骤中,便于边看边做。

Seedance 2.0 是什么(先讲结论)

从官方信息看,Seedance 2.0 重点不是“单条视频更清晰”这么简单,而是四件事:

- 全模态参考系统(All-Round Reference):可同时喂文本、图片、视频、音频。公开资料常见上限为“单次最多 12 份参考(最多 9 图、3 段视频、3 段音频)”,但不同平台的字段与上限可能不同,以控制台实际能力为准。

- 原生音画同步(Native Audio-Visual Sync):画面与声音联合生成,更适合口型同步和动作卡点场景。

- 多镜头一致性(Multi-shot Consistency):同一角色/产品在多个镜头中更容易保持身份与外观稳定。

- 首尾帧控制(First & Last Frame):可指定起始帧与结束帧,让中间过渡更可控,适合“前后对比”类内容。

这意味着它更适合广告短片、剧情片段、角色 IP 系列内容,而不只是单镜头炫技。

截至 2026-02-12 的可用性状态

为了保证时效性,这里只给执行层结论:

- ByteDance Seed 官方页面已展示 Seedance 2.0 的能力方向与评测信号。

- Dreamina 页面给出了较完整工作流,但具体可用能力仍可能分阶段开放。

- 2026-02-12 当天媒体有发布动态,但实际权限仍以账号实测为准。

实操建议:

- 你的账号能用 2.0,就直接按本文流程跑。

- 还没开通时,用同一套流程先在 1.5 Pro 跑,后续平滑迁移。

方法论变化:从“描述者”到“导演”

Seedance 2.0 的提示词思路要从“描述外观”切到“调度素材”:

- 不再死磕文字描外观:改为“主体是 @Image1 中的对象”,先锁身份。

- 不再硬写复杂运镜句子:改为“参考 @Video1 的镜头轨迹”,先锁运动。

- 不再视频做完再配音:改为“动作与 @Audio1 节奏同步”,先锁音画关系。

这三条会直接影响后面的参考喂法和 Prompt 稳定性。

第 0 步:准备素材与目标(90% 人会跳过)

先把这三件事写清楚,再开始生成:

- 目标平台:抖音/小红书/YouTube Shorts/广告投放

- 目标时长:5-8 秒做抓眼;10-12 秒做叙事

- 核心信息:这一条视频希望观众记住什么

同时准备一个“素材包”:

- 主体参考图(角色/产品)

- 风格参考图(光线、色调、镜头风格)

- 可选音频参考(语气、节奏、氛围)

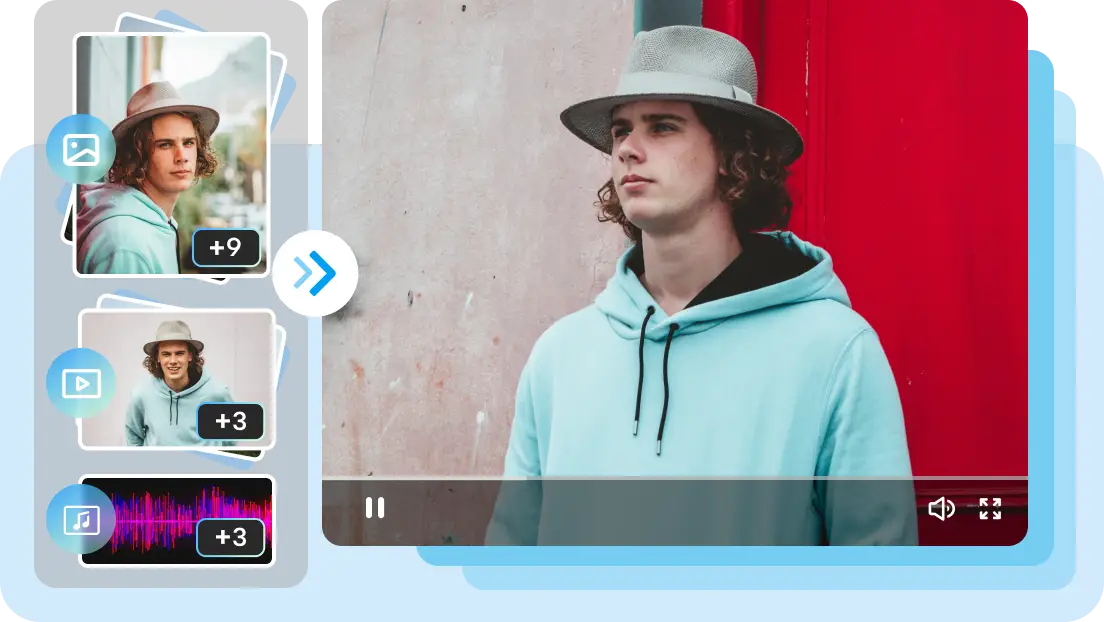

示例参考图:用于准备“身份层 + 风格层”素材。

示例参考图:用于准备“身份层 + 风格层”素材。

第 1 步:先选模式(Text-to-Video 或 Image-to-Video 或 Audio-to-Video 或Video-to-Video)

text-to-video 适合:

- 概念探索

- 还没有稳定视觉锚点

- 先验证叙事方向

image-to-video 适合:

- 已有角色或产品主视觉

- 需要高一致性

- 要做系列内容(同一 IP 连续更新)

经验法则:

- 首次创意发散用文生视频

- 一旦方向正确,马上切到图生锁一致性

建议先在 AI Video Generator 跑一条最小样例,再进入批量迭代阶段。

第 2 步:多模态参考怎么喂,才不乱

以 Dreamina 页面公开说明为例,Seedance 2.0 支持把图像、视频、音频一起作为参考输入。你可以把参考拆成四层:

- 身份层:角色脸、服装、产品外观(决定“是谁”)

- 风格层:色彩、镜头语言、后期质感(决定“长什么样”)

- 动作层:走位、镜头运动、节奏(决定“怎么动”)

- 音频层:对白语气、环境氛围、音乐节奏(决定“听起来像什么”)

实操原则:

- 每次新增参考,只加一个维度,便于定位问题。

- 一旦出现“角色漂移”,先删风格参考,保留身份参考重跑。

- 场景复杂时,优先保证主体一致性,再追求花哨镜头。

- 音频参考尽量短且单目标(先只控环境音或先只控对白),避免音画冲突。

- 如果当前只做“无声成片”测试,先关闭音频生成,确认画面稳定后再开启。

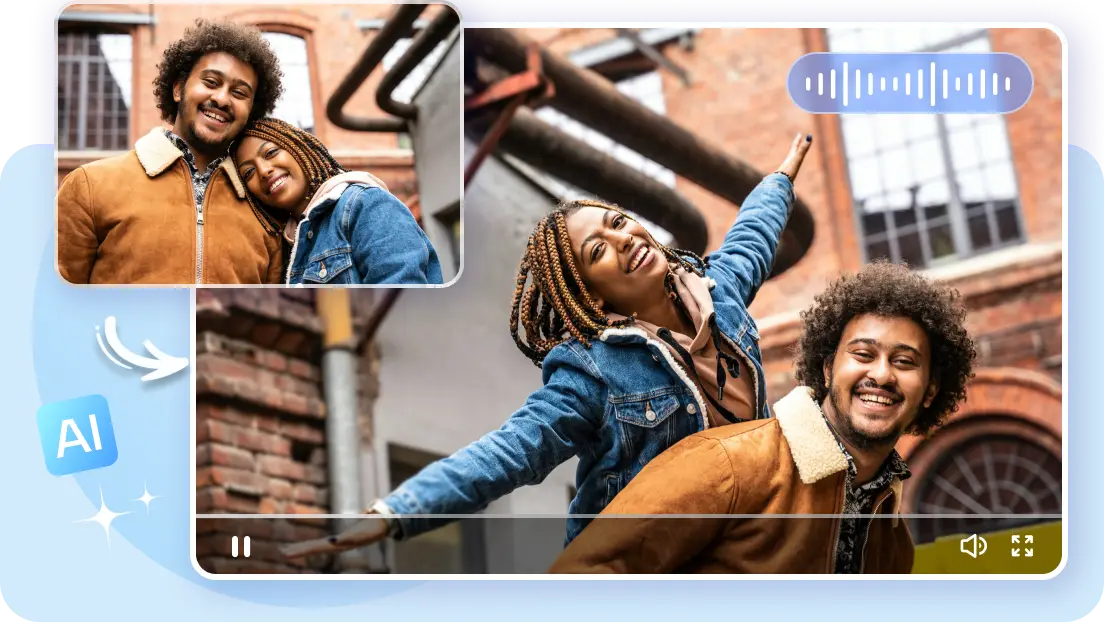

示例参考图:多模态参考组合后的风格目标。

示例参考图:多模态参考组合后的风格目标。

第 3 步:结构化 Prompt 模板(S-A-C-S-C)

很多 Seedance 2.0 输出不稳,不是模型不行,而是 Prompt 没有结构。

建议统一成一个公式:S-A-C-S-C

主体(Subject)+ 动作(Action)+ 运镜(Camera)+ 风格(Style)+ 约束(Constraints)写法要点:

- 主体(S):优先用

@Image锁身份,不重复堆砌颜色/形状细节。 - 动作(A):只写可执行的物理动作,避免长串复合动作。

- 运镜(C):用摄影术语写轨迹和速度,如

Slow Dolly-in/Fast Pan。 - 风格(S):在这里写场景、光线、材质、声音目标(例如环境音优先)。

- 约束(C):写禁止项,避免漂移和脏输出。

可复制模板:

主体(S):@Image1 中的短发女性,黑色风衣,面部身份保持一致。

动作(A):从左向右稳步行走,回头看镜头 1 次。

运镜(C):中景跟拍,Slow Dolly-in,无抖动,无突发变焦。

风格(S):夜晚霓虹街道,雨后地面反光;冷色主光,金属反射清晰;环境音为远处车流与风声。

约束(C):不换脸,不换服饰,不出现多余肢体,不出现文字水印。英文版本(适合英文界面):

Subject (S): short-haired woman from @Image1, black trench coat, keep facial identity consistent.

Action (A): she walks steadily from left to right, then looks back once.

Camera (C): medium tracking shot, Slow Dolly-in, no shake, no sudden zoom.

Style (S): neon-lit city street at night with wet reflections; cool key light; subtle distant traffic and wind ambience.

Constraints (C): no face swap, no outfit change, no extra limbs, no text watermark. 示例封面:可作为镜头质感与构图方向参考。

示例封面:可作为镜头质感与构图方向参考。

第 4 步:两组实战对照(坏提示词 vs 好提示词)

场景 1:高端手表展示

坏提示词:

展示一只漂亮的手表,很酷的背景,镜头转一下,要看起来很贵。问题:主体随机、镜头语言模糊、质感不可控。

好提示词(S-A-C-S-C):

主体(S):@Image1 中的手表,Logo 与外观比例保持一致。

动作(A):指针快速转动(延时感),表盘玻璃出现可见高光闪烁。

运镜(C):Macro shot,Slow Dolly-in 聚焦表盘,背景虚化。

风格(S):奢华商业广告质感,冷色金属光泽,85mm 焦段感。

约束(C):Logo fixed geometry,无额外文字,无表盘变形。场景 2:美妆口播 UGC

坏提示词:

一个美女拿着面霜说话,很开心,背景是卧室。问题:人物不稳定、口型不准、手部细节容易失真。

好提示词(S-A-C-S-C):

主体(S):@Image1 中的人物,手持 @Image2 中的面霜。

动作(A):自然对镜头说话,轻微点头,手部动作平稳。

运镜(C):中景,视线齐平,轻微 Handheld 呼吸感。

风格(S):明亮 UGC 博主风,环形灯眼神光;口型匹配 @Audio1 节奏。

约束(C):手部无变形,面霜文字保持清晰,无多余指头。第 5 步:参数设置建议(Seedance 2.0 常用)

不同平台会有不同参数上限,以下是通用起步值。

| 场景 | 比例 | 分辨率 | 时长 | 建议 |

|---|---|---|---|---|

| 社媒竖屏剧情 | 9:16 | 720p | 5-8s | 先保运动稳定,再升清晰度 |

| 产品广告 | 16:9 | 1080p | 8-12s | 先锁产品外观一致,再做镜头运动 |

| 人物特写 | 3:4 或 1:1 | 720p/1080p | 5-8s | 强约束脸部一致与肤色自然 |

| 预告片镜头 | 21:9 或 16:9 | 1080p | 8-12s | 强调镜头轨迹与光影层次 |

第 6 步:迭代闭环(真正决定出片率)

把每次迭代当成实验,不要一口气改 5 个变量。

推荐 4 轮:

- 构图轮:只看主体、背景、比例是否正确

- 运动轮:只改动作与镜头运动

- 质感轮:只改光线、材质、色调

- 声音轮:只改音频风格与强度

每轮保留最佳版本并记录“改了什么 -> 结果如何”,你会很快形成自己的提示词资产库。

示例视频:用于对照镜头节奏与运动稳定性。

红线与负向词库(避免无效迭代)

这部分用来减少“明明重跑很多次却不稳定”的情况:

- 有参考图就少写外观细节:文字与图像冲突会诱发幻觉(例如多出一个主体)。

- 避免复合动作长句:把“跑、跳、转身、喝水”拆成多个镜头分别生成。

- Logo 场景要加几何约束:优先加

Logo fixed geometry,必要时后期贴图。 - 负向词建议常驻:

Distorted text、Morphing、Extra fingers、Shaky camera。

常见失败与修复

| 问题 | 常见原因 | 修复动作 |

|---|---|---|

| 角色不一致 | 身份参考过弱 | 增加身份描述,减少风格干扰 |

| 镜头乱飘 | Prompt 里没写镜头轨迹 | 明确写 tracking/dolly/pan 与速度 |

| 画面像 AI 味太重 | 材质与光线描述缺失 | 增加镜头、光照、材质细节词 |

| 音画不同步 | 声音目标不清晰 | 明确“环境音/对白/音乐”优先级 |

| 细节抖动 | 动作描述过多且冲突 | 简化动作,拆成多条短片生成 |

开发者加速版:API 最小可用流程(VibeVideo)

如果你在做自动化生产,直接对接你们站内 API。完整参数说明见:VibeVideo 视频生成 API 文档(中文)。 如果你要做“同 Prompt 的可视化对照”,可同时在 AI Video Generator 跑网页流程对比结果。

1) 创建任务(POST /api/ai/generate)

curl -X POST "https://vibevideo.app/api/ai/generate" \

-H "Authorization: Bearer <YOUR_API_KEY>" \

-H "Content-Type: application/json" \

-d '{

"mediaType": "video",

"scene": "image-to-video",

"model": "bytedance/v1-pro-image-to-video",

"prompt": "Cinematic neon street at dusk, realistic motion, smooth tracking shot, stable subject consistency.",

"options": {

"mode": "image-to-video",

"image_url": "https://example.com/first-frame.png",

"resolution": "720p",

"duration": 5,

"aspect_ratio": "9:16",

"camera_fixed": false,

"generate_audio": false

}

}'2) 查询任务结果(POST /api/ai/query)

curl -X POST "https://vibevideo.app/api/ai/query" \

-H "Authorization: Bearer <YOUR_API_KEY>" \

-H "Content-Type: application/json" \

-d '{

"taskId": "YOUR_TASK_ID"

}'生产建议:

- 使用

data.id(VibeVideo 任务 ID)作为查询入参。 - 关注

status(pending/processing/success/failed/canceled)并按状态做重试或告警。 - 任务成功后及时落盘

taskResult对应的输出资源,避免临时链接过期。

FAQ

Seedance 2.0 和普通 AI 视频工具最大区别是什么?

核心差异是多模态参考与多镜头叙事一致性,尤其适合要“连续镜头”和“角色稳定”的项目。

Seedance 2.0 更适合文生还是图生?

都适合。文生适合探索创意,图生适合锁定角色与品牌素材。

如何提升 Seedance 2.0 成片稳定性?

先锁身份,再写镜头轨迹,再单变量迭代。不要一次改太多参数。

如果我现在还没有 2.0 权限怎么办?

先用 1.5 Pro 跑相同工作流与提示词框架,权限开放后,选seedance 2就行了。

需要每次都开音频生成吗?

不需要。只在确实需要口型、环境音或对白同步时开启,避免无效成本。

哪类项目最适合 Seedance 2.0?

广告短片、剧情短视频、IP 系列内容、电视产品白底视频生成这四类收益通常最高。

准备开跑的话,可直接进入 AI Video Generator,或先去 VibeVideo 首页 查看更多模型入口与示例。

参考资料

- VibeVideo 视频生成 API 文档(中文):https://vibevideo.app/docs/api/video-generation

- VibeVideo Video Generation API (EN): https://vibevideo.app/docs/api/video-generation

- ByteDance Seed 官方页(Seedance 2.0):https://seed.bytedance.com/en/seedance2_0

- ByteDance Seed 官方页(Seedance 1.0):https://seed.bytedance.com/en/seedance

- Dreamina Seedance 2.0 页面与教程:https://dreamina.capcut.com/tools/seedance-2-0