Si vous cherchez un tutoriel Seedance 2 vraiment exploitable, ce guide vous donne un workflow de production reutilisable que vous pouvez appliquer immediatement.

- Les debutants peuvent s'en servir pour produire leur premier clip publiable.

- Les createurs intermediaires peuvent ameliorer la stabilite du mouvement et la coherence des personnages.

- Les developpeurs peuvent brancher des APIs et industrialiser les generations.

Si vous voulez tester tout de suite, ouvrez le Generateur video IA ou revenez a la page d'accueil VibeVideo.

Conclusion d'abord

- La valeur cle de Seedance 2.0 repose sur le controle multimodal : texte, image, video et audio.

- La methode la plus fiable est la suivante : verrouiller les references, structurer le prompt, puis n'iterer qu'une variable a la fois.

- Au 12 fevrier 2026, la disponibilite varie encore selon les plateformes. Si vous n'avez pas encore acces a Seedance 2.0, appliquez le meme workflow sur Seedance 1.5 Pro.

Les exemples media sont integres au fil des sections afin de comparer directement theorie et pratique.

Ce qu'est Seedance 2.0

D'apres les informations publiques, Seedance 2.0 ne se limite pas a "des videos plus nettes". Les gains les plus importants sont :

- Controle complet des references : texte, images, videos et audio peuvent etre combines dans un meme run.

- Synchronisation audio-video native : utile pour les clips avec dialogues, rythme musical ou ambience forte.

- Meilleure coherence multi-plans : l'identite et la continuite visuelle sont plus faciles a conserver.

- Controle de la premiere et de la derniere image : les transitions deviennent beaucoup plus previsibles.

Cela rend Seedance 2.0 particulierement pertinent pour les films publicitaires, les clips narratifs courts et les workflows recurrrents autour d'un personnage ou d'une IP.

Etat de disponibilite (au 12 fevrier 2026)

Pour garder ce tutoriel date correctement :

- les pages officielles ByteDance Seed presentent deja le cadre de capacites de Seedance 2.0 ;

- la page Dreamina de Seedance 2.0 documente un workflow complet, meme si certaines disponibilites restent progressives ;

- les annonces media du 12 fevrier 2026 ont confirme le lancement, mais l'acces reel semble encore deploye par etapes.

Recommandation pratique :

- si Seedance 2.0 est deja disponible sur votre compte, utilisez-le directement ;

- sinon, appliquez exactement ce workflow sur Seedance 1.5 Pro, puis migrez vers 2.0 quand l'acces est ouvert.

Changement de methode : decrire moins, diriger davantage

Avec Seedance 2.0, un bon prompting consiste moins a tout decrire qu'a mettre en scene vos ressources :

- Ne sur-decrivez pas l'apparence : utilisez des references

@Imagepour verrouiller d'abord l'identite. - N'empilez pas des indications camera complexes dans une seule phrase : appuyez-vous sur une reference de mouvement quand c'est possible.

- Ne traitez pas l'audio comme un detail secondaire : fixez l'objectif de rythme et de synchronisation tres tot.

Ce changement de posture rend les iterations bien plus coherentes et reproductibles.

Etape 0 : definir d'abord les ressources et l'objectif

Avant toute generation, clarifiez ces trois points :

- plateforme cible : TikTok, YouTube Shorts, Instagram Reels, creatives publicitaires ;

- duree cible : 5 a 8 secondes pour un hook, 10 a 12 secondes pour une scene narrative ;

- message principal : ce que le spectateur doit retenir.

Preparez ensuite un kit de ressources :

- une image de reference d'identite (personnage ou produit) ;

- une image de reference de style (lumiere, palette, langage camera) ;

- si besoin, une reference audio (ambiance, rythme, ton).

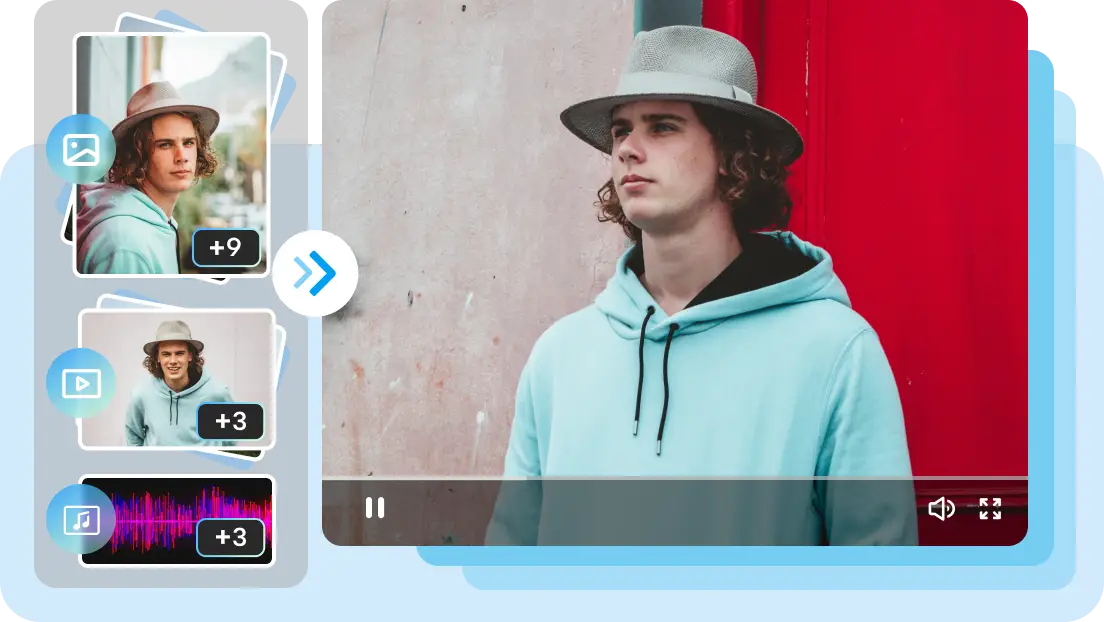

Exemple : verrouillage de l'identite et du style.

Exemple : verrouillage de l'identite et du style.

Etape 1 : choisir le bon mode

Le text-to-video est preferable si :

- vous explorez encore le concept ;

- vous n'avez pas de visuel hero definitif ;

- vous voulez valider vite une direction narrative.

Le image-to-video est preferable si :

- vous avez deja une image cle ou un premier frame valide ;

- vous avez besoin d'une plus forte coherence ;

- vous produisez une serie autour du meme personnage ou du meme produit.

Regle simple :

- commencez en texte-vers-video pour l'ideation ;

- passez en image-vers-video des que la direction est validee.

Pour une validation rapide, lancez d'abord un test dans le Generateur video IA avant d'automatiser.

Etape 2 : ajouter des references multimodales sans chaos

La documentation publique de Dreamina montre que Seedance 2.0 accepte images, videos et audio dans un meme workflow. Une methode stable consiste a organiser vos references en quatre couches :

- Couche identite : visage, tenue, silhouette produit

- Couche style : palette, optique, texture de post-production

- Couche mouvement : blocking, trajectoire camera, rythme

- Couche audio : ambiance, voix, pulsation musicale

Regles d'execution :

- ajoutez une seule nouvelle dimension de reference par run ;

- si l'identite derive, reduisez le bruit stylistique et renforcez les ancres d'identite ;

- dans les scenes complexes, privilegiez d'abord la coherence du sujet avant les mouvements camera trop ambitieux ;

- gardez des references audio courtes et mono-objectif ;

- si vous testez seulement la stabilite visuelle, coupez d'abord la generation audio.

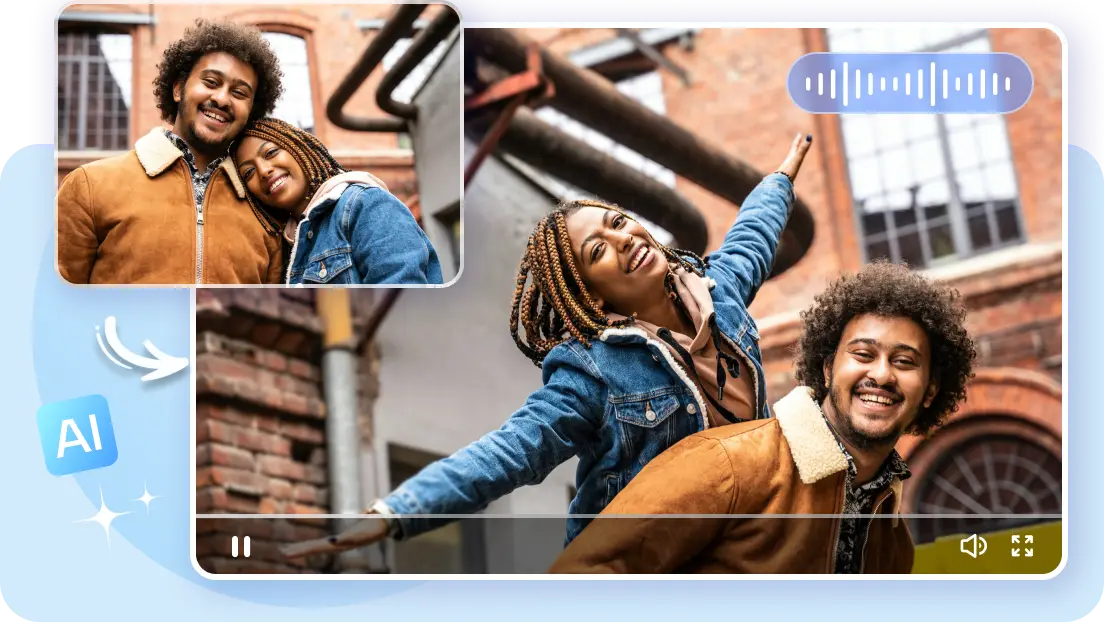

Exemple : fusion de references multimodales vers un style cible unique.

Exemple : fusion de references multimodales vers un style cible unique.

Etape 3 : utiliser un template de prompt structure (S-A-C-S-C)

Quand un rendu parait instable, le probleme vient souvent de la structure du prompt, pas du modele.

Utilisez toujours la meme formule : S-A-C-S-C

Sujet + Action + Camera + Style + ContraintesRegles d'ecriture :

- Sujet (S) : verrouillez d'abord l'identite via les references

@Image. - Action (A) : decrivez une action physique concrete, pas une suite de micro-evenements.

- Camera (C) : indiquez le trajet et la vitesse avec un vocabulaire cinema.

- Style (S) : regroupez decor, lumiere, texture, ambiance et objectif audio.

- Contraintes (C) : indiquez clairement ce qui ne doit pas changer.

Template pret a copier :

Sujet (S) : femme aux cheveux courts issue de @Image1, manteau noir type trench, conserver une identite faciale constante.

Action (A) : elle marche regulierement de gauche a droite, puis se retourne une seule fois.

Camera (C) : plan moyen en suivi, slow dolly-in, aucun tremblement, aucun zoom brusque.

Style (S) : rue neon de nuit avec reflets humides, lumiere principale froide, trafic lointain et ambience venteuse discrete.

Contraintes (C) : aucun face swap, aucun changement de tenue, aucun membre supplementaire, aucun texte en filigrane. Image de reference utile pour juger le niveau de qualite et la composition.

Image de reference utile pour juger le niveau de qualite et la composition.

Etape 4 : deux contrastes de prompt (mauvais vs bon)

Cas 1 : packshot de montre premium

Mauvais prompt :

Montrer une belle montre avec un joli fond. Bouger la camera et donner un rendu premium.Probleme : sujet aleatoire, intention camera trop vague, qualite visuelle instable.

Bon prompt (S-A-C-S-C) :

Sujet (S) : montre issue de @Image1, conserver la forme du logo et les proportions du produit.

Action (A) : rotation rapide des aiguilles, avec un leger scintillement controle sur le verre.

Camera (C) : macro shot, slow dolly-in vers le cadran, flou d'arriere-plan doux.

Style (S) : rendu publicitaire luxe, tonalites metalliques froides, sensation d'optique 85 mm.

Contraintes (C) : geometrie du logo fixe, aucun texte supplementaire, aucune deformation du cadran.Cas 2 : clip UGC beaute avec prise de parole

Mauvais prompt :

Une femme tient une creme et parle joyeusement dans une chambre.Probleme : derive d'identite, lip-sync faible, mains souvent degradees.

Bon prompt (S-A-C-S-C) :

Sujet (S) : personne issue de @Image1 tenant la creme visible dans @Image2.

Action (A) : prise de parole naturelle face camera, leger hochement de tete, mouvement de main stable.

Camera (C) : plan moyen a hauteur des yeux, respiration camera tres legere a l'epaule.

Style (S) : rendu UGC lumineux avec reflet de ring light ; lip-sync aligne sur le rythme de @Audio1.

Contraintes (C) : aucune deformation des mains, texte de l'etiquette lisible, aucun doigt supplementaire.Etape 5 : base de parametres

Les limites exactes dependent de la plateforme. Utilisez ceci comme point de depart.

| Scenario | Ratio | Resolution | Duree | Recommandation |

|---|---|---|---|---|

| Narration sociale verticale | 9:16 | 720p | 5-8s | Stabiliser le mouvement avant d'augmenter le detail |

| Publicites produit | 16:9 | 1080p | 8-12s | Verrouiller le produit avant d'ajouter des mouvements complexes |

| Portraits rapproches | 3:4 ou 1:1 | 720p/1080p | 5-8s | Ajouter de fortes contraintes d'identite et de teinte peau |

| Plans type trailer | 21:9 ou 16:9 | 1080p | 8-12s | Mettre l'accent sur le trajet camera et les couches de lumiere |

Comparez le rythme et la stabilite du mouvement avec vos propres sorties.

Etape 6 : boucle d'iteration

Traitez chaque run comme une experience. Ne modifiez pas cinq variables d'un coup.

Boucle recommandee en quatre passes :

- Composition : ne jugez que le sujet, l'arriere-plan et le cadrage

- Mouvement : ajustez seulement l'action et la camera

- Texture : ajustez seulement la lumiere, la matiere et la couleur

- Audio : ajustez seulement le style sonore et l'intensite

Conservez la meilleure version a chaque tour et notez : "ce qui a change -> ce qui s'est ameliore". C'est ainsi qu'un simple tutoriel devient un playbook interne durable.

Lignes rouges et lexique negatif

Pour eviter des iterations perdues :

- si vous fournissez deja des images de reference, reduisez le texte descriptif d'apparence ;

- evitez les actions composees trop longues comme "courir, sauter, tourner, boire" dans un seul plan ;

- verrouillez explicitement les logos si la precision de marque est critique ;

- gardez un lexique negatif par defaut :

texte deforme,morphing,doigts supplementaires,camera instable.

Echecs frequents et correctifs

| Probleme | Cause typique | Correctif |

|---|---|---|

| Incoherence du personnage | Ancre d'identite trop faible | Renforcer la description d'identite et reduire le bruit stylistique |

| Camera flottante ou chaotique | Pas de trajet camera explicite | Preciser tracking, dolly, pan et vitesse |

| Rendu "trop IA" | Contraintes de matiere et de lumiere absentes | Ajouter des mots de texture, d'optique et d'eclairage |

| Desynchronisation audio-video | Objectif sonore mal defini | Prioriser explicitement ambiance, dialogue ou musique |

| Clignotement de details | Trop d'instructions de mouvement contradictoires | Simplifier l'action et fractionner en runs plus courts |

Raccourci developpeur : flux API minimal (VibeVideo)

Pour automatiser, utilisez directement les endpoints API natifs de VibeVideo.

Reference complete : VibeVideo Video Generation API.

1) Creer une tache (POST /api/ai/generate)

curl -X POST "https://vibevideo.app/api/ai/generate" \

-H "Authorization: Bearer <YOUR_API_KEY>" \

-H "Content-Type: application/json" \

-d '{

"mediaType": "video",

"scene": "image-to-video",

"model": "bytedance/v1-pro-image-to-video",

"prompt": "Rue neon au crepuscule, mouvement realiste, travelling fluide, sujet stable sur l'ensemble du plan.",

"options": {

"mode": "image-to-video",

"image_url": "https://example.com/first-frame.png",

"resolution": "720p",

"duration": 5,

"aspect_ratio": "9:16",

"camera_fixed": false,

"generate_audio": false

}

}'2) Interroger une tache (POST /api/ai/query)

curl -X POST "https://vibevideo.app/api/ai/query" \

-H "Authorization: Bearer <YOUR_API_KEY>" \

-H "Content-Type: application/json" \

-d '{

"taskId": "YOUR_TASK_ID"

}'Notes de production :

- utilisez

data.id(l'identifiant de tache VibeVideo) comme entree de requete ; - gerez les transitions de statut (

pending/processing/success/failed/canceled) avec retries ou alertes ; - persistez les assets de sortie apres succes afin d'eviter l'expiration de liens temporaires.

FAQ

Qu'est-ce qui distingue Seedance 2.0 des outils video IA classiques ?

Le point cle, c'est le controle multimodal des references et une meilleure coherence entre plusieurs plans. C'est la raison pour laquelle ce workflow est tres utile pour les campagnes et les mini-recits.

Seedance 2.0 est-il meilleur en texte-vers-video ou en image-vers-video ?

Les deux modes sont utiles. Le texte convient mieux a l'ideation ; l'image est plus forte pour verrouiller l'identite et la coherence de marque.

Comment ameliorer rapidement la stabilite du rendu ?

Verrouillez l'identite en premier, puis definissez un trajet camera clair, puis iterez une seule variable a la fois.

Que faire si je n'ai pas encore acces a Seedance 2.0 ?

Appliquez exactement ce process sur Seedance 1.5 Pro. Lorsque l'acces 2.0 sera ouvert, migrez vos prompts et vos parametres avec de petits ajustements.

Faut-il generer de l'audio a chaque run ?

Non. Activez l'audio seulement quand la synchronisation est un objectif du run, par exemple pour le dialogue, l'ambiance ou le rythme musical.

Quels projets profitent le plus de ce workflow ?

Les publicites courtes, les clips narratifs pour les reseaux sociaux, les series de personnages/IP et les prototypes cinematographiques beneficient le plus de ce workflow.

Si vous etes pret a lancer une production, allez directement sur le Generateur video IA ou parcourez la page d'accueil pour retrouver les modeles et les mises a jour produit.

References

- VibeVideo Video Generation API (EN) : https://vibevideo.app/docs/api/video-generation

- Page officielle ByteDance Seed (Seedance 2.0) : https://seed.bytedance.com/en/seedance2_0

- Page officielle ByteDance Seed (Seedance 1.0) : https://seed.bytedance.com/en/seedance

- Page Dreamina Seedance 2.0 : https://dreamina.capcut.com/tools/seedance-2-0